Cómo exportar la configuración de un cortafuegos SonicWall via cli (SSH).

Cómo exportar la configuración de un cortafuegos SonicWall via cli (SSH).

Exportar la configuración de un firewall SonicWall es una práctica esencial para tener copias de seguridad, migrar configuraciones entre dispositivos o documentar cambios. En SonicOS, puedes hacerlo fácilmente desde la línea de comandos utilizando la Enterprise CLI (E-CLI) y un servidor FTP accesible desde la red. En este artículo te explico paso a paso cómo exportar la configuración actual o pendiente, en diferentes formatos, directamente desde la CLI.

Requisitos previos

Para poder exportar configuraciones por FTP, necesitas tener un servidor FTP ya instalado y accesible desde el firewall. Asegúrate de que la carpeta del FTP tenga permisos de lectura y escritura, ya que ahí se almacenarán los archivos exportados. Además, deberás usar una URL con el formato `ftp://usuario:contraseña@IP/archivo`, como en los ejemplos que verás a continuación.

Conéctate al SonicWall usando la CLI, ya sea por SSH o por consola, con un usuario con permisos de administración (generalmente `admin`).

Si vas a exportar la configuración pendiente (es decir, cambios aún no aplicados), deberás entrar en el modo `config`. Este paso no es obligatorio si solo quieres exportar la configuración activa.

Formatos de exportación disponibles

SonicWall permite exportar la configuración en dos formatos: SonicOS y CLI.

El formato SonicOS genera un archivo con extensión `.exp`. Este es un respaldo binario que puede importarse más adelante desde la interfaz web. Es ideal para restauraciones completas.

Por otro lado, el formato CLI genera un archivo de texto plano (normalmente con extensión `.wri`) que contiene los comandos equivalentes en E-CLI. Es útil para analizar configuraciones, compartirlas con otros administradores o versionarlas en sistemas de control de cambios como Git.

Ten en cuenta que si quieres exportar la configuración pendiente (la que aún no ha sido confirmada con un `commit`), solo podrás hacerlo en formato CLI, y únicamente desde dentro del modo "config".

Comandos para exportar configuración

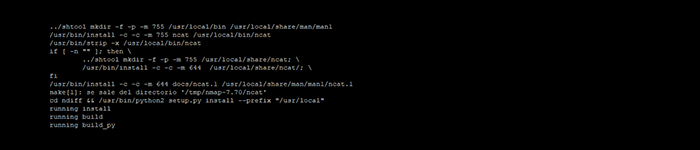

A continuación, te muestro los comandos que puedes usar. Sustituye las direcciones IP, usuario, contraseña y nombres de archivo según tu entorno:

Para exportar la configuración activa en formato SonicOS (.exp):

export current-config sonicos ftp ftp://test:test@10.10.10.2/sonicos.exp

Para exportar la configuración activa en formato CLI (.wri):

export current-config cli ftp ftp://test:test@10.10.10.2/sonic-cli.wri

Para exportar la configuración pendiente en formato CLI (.wri), primero entra en modo `config`:

config

export pending-config cli ftp ftp://test:test@10.10.10.2/sonic-cli-pending.wri

Procedimiento paso a paso

Primero, asegúrate de que tu servidor FTP está correctamente configurado y disponible. Verifica la conectividad desde el firewall haciendo ping a su IP. Luego, accede a la CLI del SonicWall usando un cliente SSH o consola y autentícate con el usuario `admin`.

Ejecuta el comando de exportación que necesites, dependiendo del formato deseado. El archivo exportado aparecerá en el directorio del servidor FTP si todo ha salido bien.

Si quieres importar el archivo `.exp` más adelante, puedes hacerlo desde la interfaz web en la sección “Firmware & Backups”. En el caso de los archivos `.wri`, puedes abrirlos con cualquier editor de texto o aplicarlos manualmente desde la CLI.

Consejos de seguridad y buenas prácticas

* Si es posible, utiliza SFTP o FTPS en lugar de FTP sin cifrar, especialmente en entornos de producción.

* Guarda los archivos `.wri` en un repositorio seguro para mantener un historial de cambios.

* Considera automatizar la exportación con scripts programados, por ejemplo usando `cron`.

* Asegúrate de que el servidor FTP esté aislado y accesible únicamente desde redes de gestión.

* Antes de restaurar una configuración en otro equipo, verifica que ambos usen la misma versión de firmware para evitar problemas de compatibilidad.

Conclusión

Exportar la configuración de un firewall SonicWall es un proceso sencillo si utilizas la CLI junto con un servidor FTP externo. Con estos comandos puedes generar copias de seguridad legibles que faciliten la gestión, el análisis y la recuperación de la configuración ante fallos del equipo.